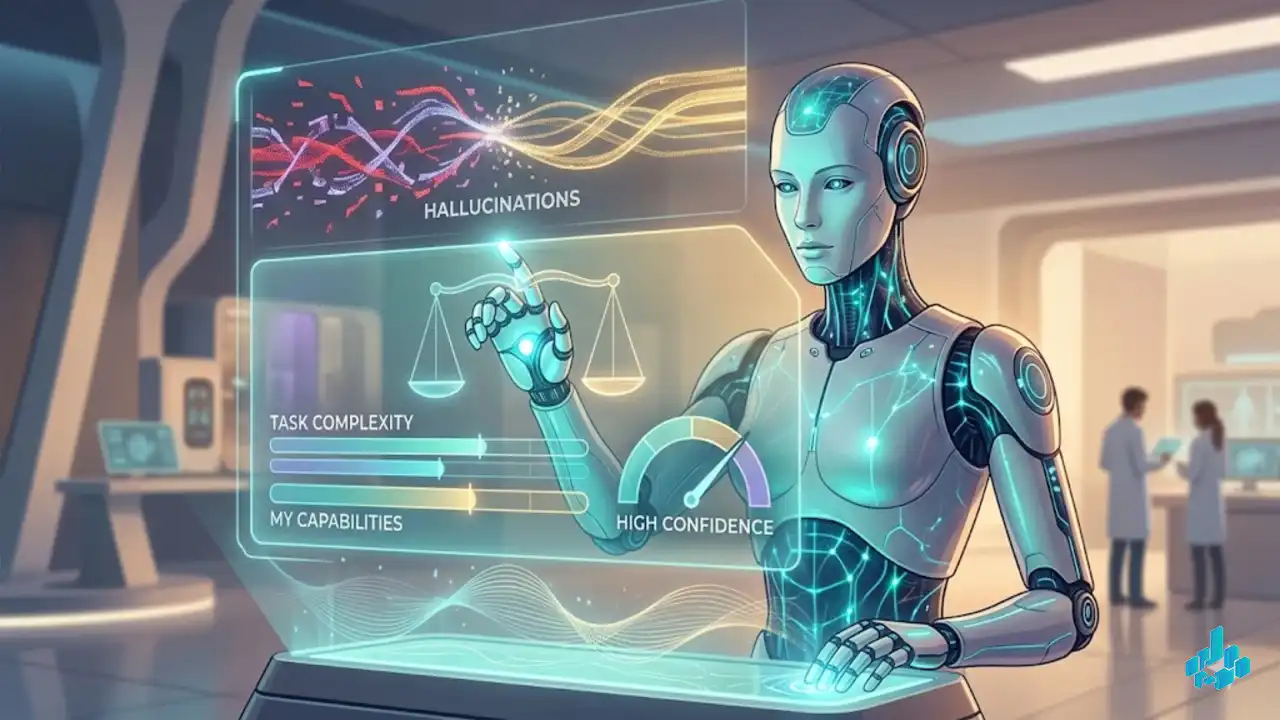

Hasta ahora, los agentes a menudo intentaban completar una tarea incluso cuando carecían de las herramientas (API) o el contexto necesarios, lo que resultaba en la generación de respuestas basura. Appier propone una métrica de evaluación: antes de actuar, el agente calcula su confianza en el éxito. Si la puntuación es baja, el modelo aborta la ejecución y llama a una función externa (llamada a herramienta) o solicita ayuda directamente al desarrollador. Este es un parche crítico para Agentic AI, que hace que el comportamiento de los bots sea predecible y adecuado para la producción en el sector B2B.

Fuente: Appier / arXiv / GitHub

InvestigaciónAppierCalibración de LLMAgentic AIAprendizaje Automático