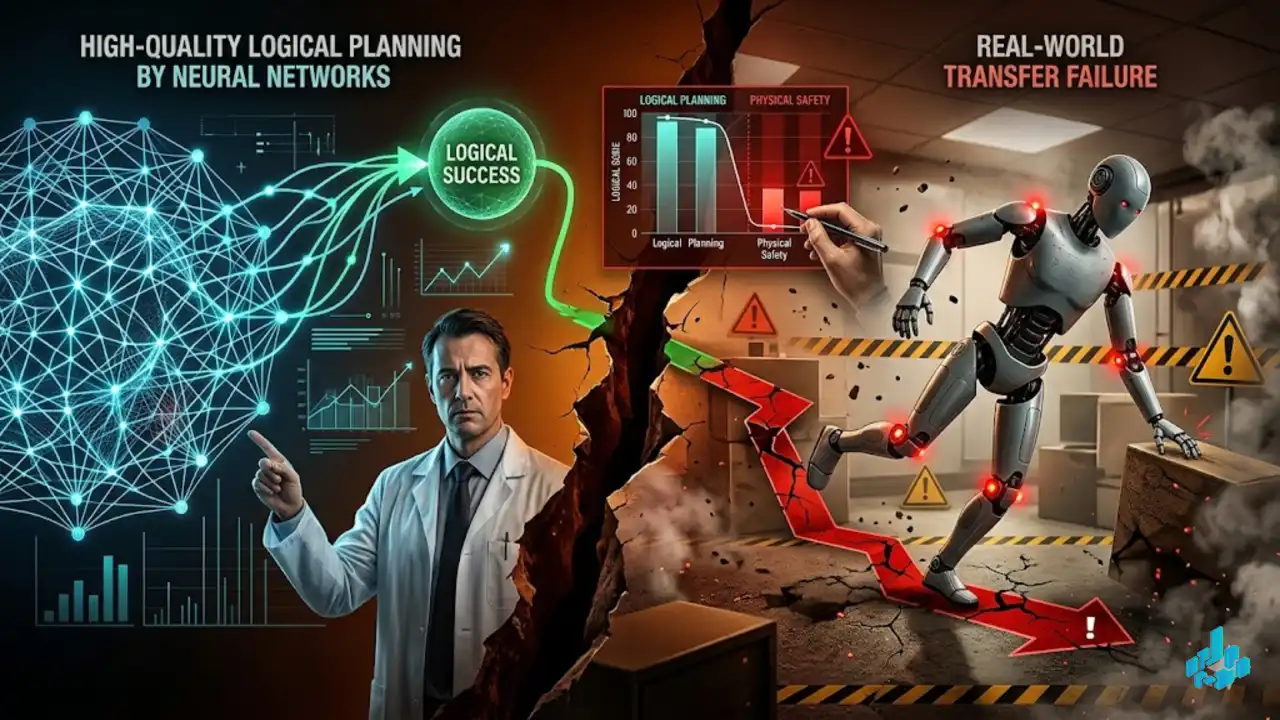

El trabajo arroja luz sobre una vulnerabilidad crítica: incluso si un algoritmo construye planes lógicos a la perfección, esto no garantiza su seguridad cuando se transfieren al chasis de un robot. Al analizar 12.279 tareas, los científicos demostraron que los modelos fundamentales son propensos a generar secuencias de acciones peligrosas o impredecibles en un entorno del mundo real. En el contexto de los maratones de humanoides chinos (caso del 19 de abril) y el despliegue de las plataformas AGIBOT, la investigación suena como una señal de alto para la industria. Sin limitadores físicos incorporados (safety guardrails), la comercialización de la IA Encarnada podría resultar en desastres provocados por el hombre.

Fuente: ETH Zúrich / arXiv

RobóticaSeguridad de IAIA EncarnadaDESPITEInvestigación