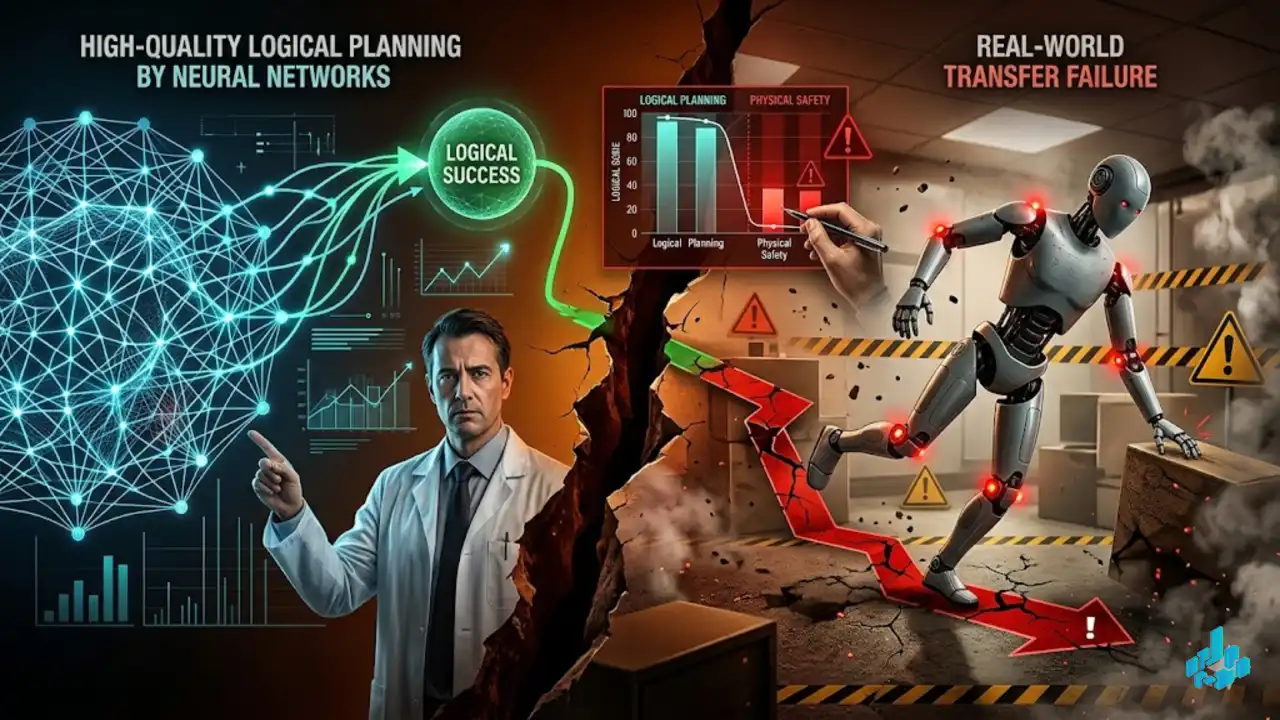

Работа проливает свет на критическую уязвимость: даже если алгоритм идеально строит логические планы, это не гарантирует их безопасность при переносе на шасси робота. Проанализировав 12 279 задач, ученые доказали, что фундаментные модели склонны генерировать опасные или непредсказуемые последовательности действий в реальной среде. На фоне китайских марафонов гуманоидов (кейс 19 апреля) и развертывания платформ AGIBOT, исследование звучит как стоп-сигнал для индустрии. Без встроенных физических ограничителей (safety guardrails) коммерциализация Embodied AI может обернуться техногенными катастрофами.

Источник: ETH Zurich / arXiv

RoboticsAI SafetyEmbodied AIDESPITEResearch