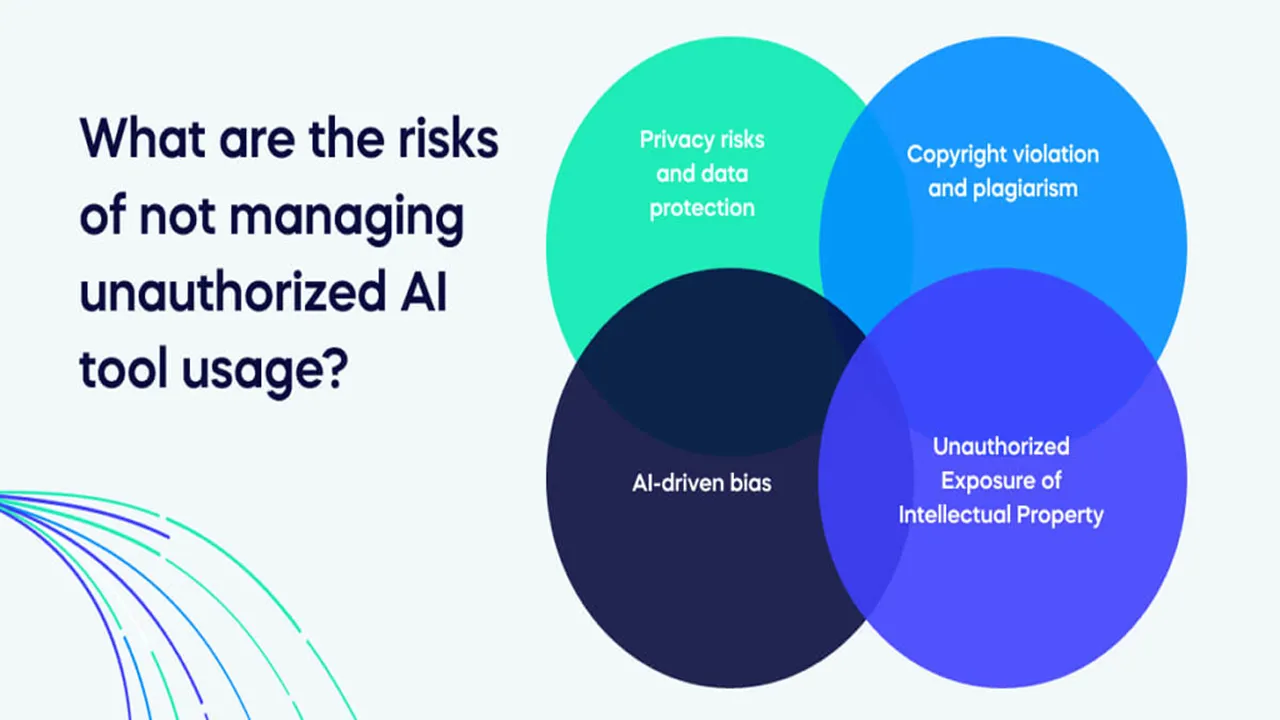

Un informe de BNN Bloomberg del 24 de agosto de 2025 arroja luz sobre una creciente amenaza para la seguridad corporativa: el uso de herramientas de IA no autorizadas por parte de los empleados, también conocido como Shadow AI. En un esfuerzo por aumentar su productividad, los trabajadores recurren cada vez más a los servicios públicos de IA generativa, pegando en ellos información confidencial, como fragmentos de código, datos financieros, listas de clientes y comunicaciones internas. Esto crea graves riesgos de fuga de propiedad intelectual y violaciones de cumplimiento, en particular de las leyes de protección de datos como el RGPD. Los expertos en seguridad entrevistados para el informe advierten que los datos introducidos en los modelos de IA públicos pueden ser utilizados para el entrenamiento y posteriormente aparecer en las respuestas a otros usuarios. La solución no es una prohibición total, sino el desarrollo de una política corporativa clara: proporcionar a los empleados versiones empresariales seguras y verificadas de las herramientas de IA, y llevar a cabo una formación obligatoria sobre prácticas de uso seguro y la inaceptabilidad de compartir datos confidenciales con servicios externos.

Informe: El Uso de IA no Autorizada por Empleados Pone en Riesgo a las Empresas