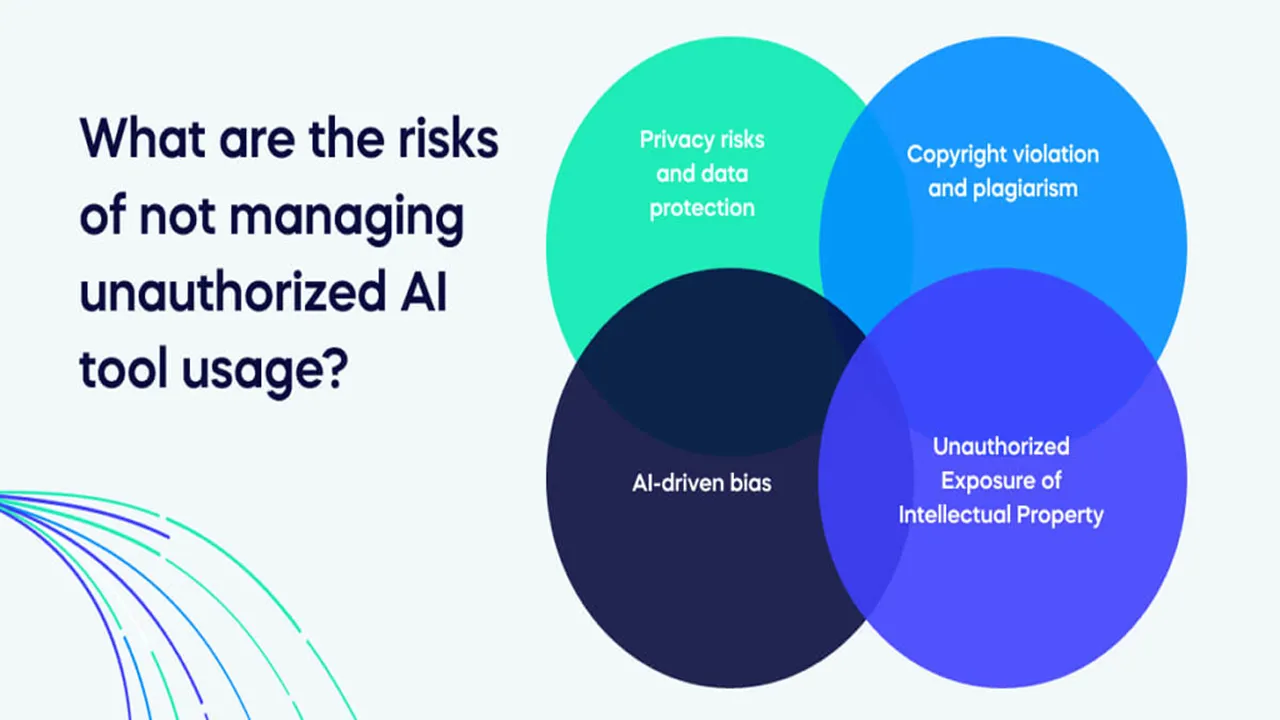

Репортаж BNN Bloomberg от 24 августа 2025 года проливает свет на растущую угрозу для корпоративной безопасности — использование сотрудниками неавторизованных ИИ-инструментов, также известное как теневой ИИ. Стремясь повысить свою продуктивность, работники все чаще обращаются к общедоступным генеративным ИИ-сервисам, копируя в них конфиденциальную информацию: фрагменты кода, финансовые данные, списки клиентов и внутреннюю переписку. Это создает серьезные риски утечки интеллектуальной собственности и нарушения комплаенса, в частности законов о защите данных, таких как GDPR. Эксперты по безопасности, опрошенные изданием, предупреждают, что данные, введенные в публичные ИИ-модели, могут быть использованы для обучения и впоследствии всплыть в ответах для других пользователей. Решением проблемы является не тотальный запрет, а разработка четкой корпоративной политики: предоставление сотрудникам безопасных, проверенных enterprise-версий ИИ-инструментов, а также обязательное обучение правилам безопасного использования и информирование о недопустимости передачи конфиденциальных данных внешним сервисам.

Отчет: Сотрудники, использующие неавторизованный ИИ, создают риски для бизнеса