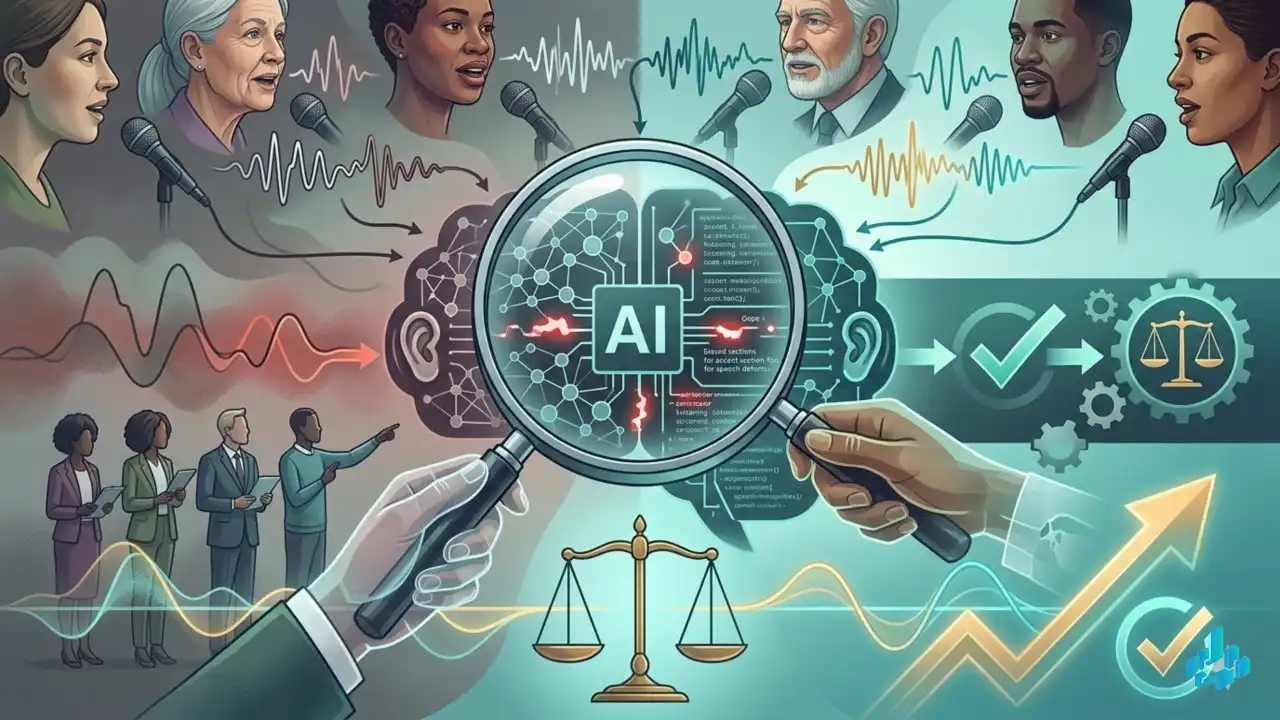

Проблема корпоративного ИИ в том, что бенчмарки пишутся самими разработчиками в стерильных условиях. В результате ASR-системы отлично понимают идеальный английский, но игнорируют акценты, дефекты речи или диалекты маргинализированных групп. Публикация предлагает стандартизировать внешний аудит ИИ с привлечением реальных пользователей и общественных групп. Это четкий сигнал регуляторам (в том числе авторам EU AI Act): безопасность алгоритмов должна оцениваться не по корпоративным отчетам, а по метрикам инклюзивности "в полях".

Источник: Nature Machine Intelligence

EthicsASRAuditingRegulationInclusivity